文/VR陀螺 ZJ

剑桥大学、牛津大学和伦敦大学学院的研究人员宣布开发出一种专为汽车平视显示器(HUD)设计的AR全息系统,该系统利用激光雷达(LiDAR)点云投射4K视频。这项技术通过显示实时3D全息图像,在尺寸和距离上与现实世界中的物体保持一致,为驾驶员提供潜在道路危险的全面视图,从而大大提高了道路安全性。

研究人员表示,识别隐藏在驾驶员视野之外的道路障碍物可确保交通道路安全。目前的驾驶辅助系统(如2D HUD)仅限于汽车挡风玻璃上的投影区域。为此,研究团队开发了一种AR全息点云视频投影系统,可在驾驶员视野范围内显示与现实物体大小和距离一致的物体。

该系统用3D激光扫描仪收集的光探测和LiDAR点云数据转换成由40万个点组成的分层3D回放场对象。GPU加速计算生成实时全息图的速度是CPU处理时间的16.6倍。全息投影是通过空间光调制器(SLM,3840×2160 px)和虚拟菲涅尔透镜实现的,它能将驾驶员的Eye Box放大到25 mm × 36 mm。

3D投影可从驾驶员视野的任何角度提供危险信息,并让驾驶员的注意力始终集中在道路上而不是挡风玻璃上,并通过投影显示隐藏在驾驶员视野之外的道路障碍物来提供帮助。

通过全息投影展示道路障碍

研究人员在其论文中指出,预计互联和自动驾驶汽车市场价值将从2022年的16亿美元增长到2028年的110亿美元。自动驾驶汽车有助于减少因人为失误导致的事故数量,并提高交通舒适度。基于点云的互联汽车技术可在不同交通场景下提供实时交通数据,从而增强障碍物和交通检测机制。车对车、车对路边基础设施等“车对万物(V2X)”技术在确保公共道路安全和安保的准确性方面变得越来越重要。

由此,基于微机电系统(MEMS)的光探测和测距(LiDAR)平台被开发出来,以促进运输过程中的安全问题。自动驾驶汽车(SAE国际标准J3016中的第4级自动驾驶)依赖于结合传感和数据处理技术的视觉系统。目前,Uber、Waymo、宝马和丰田主要利用MEMSLiDAR生成100米范围内周围环境的精准3D地图。由于分辨率标准的原因,LiDAR传感器目前还不符合第4级自动驾驶车辆在公共道路上行驶的安全标准(ISO/TS 19 159)。

为此,研究团队开发了一套4K全息装置,用于在360°视频模式下显示LiDAR导出的点云对象,以实现精准的障碍物检测和驾驶员警报系统。为驾驶员投影360°障碍物评估的概念源于细致的数据处理,这些数据能确保每个物体的深度清晰可见。

虽然从不同地点收集更多数据可提高准确性,但该研究的独特之处在于,通过从特定物体(如卡车、建筑物)的单次扫描中明智地选择数据点,以实现360°视角。这种方法能够对道路危险进行全面评估,是HUD研究的创新之举,满足了驾驶员安全的关键需求。

此外,这项工作还展示了一种3D点云方法的GPU增强加速,该方法能够将选定的LiDAR 4K 3D物体实时整合到驾驶员的视野中。使用地面LiDAR扫描仪增强了驾驶员对公共道路上隐藏障碍物的视野。

这项工作解决了驾驶员目前面临的挑战。现在人们通常使用HUD将2D投影仪投射到挡风玻璃的一小块区域,以实现信息娱乐的目的。这迫使驾驶员需要在行驶过程中将视线从路面转移到挡风玻璃上,这可能会分散驾驶员对主要驾驶任务的注意力。

本论文中描述的方法和结果主要针对当前的驾驶辅助系统,以进行导航和减少道路事故。这项工作的新颖性体现在三个方面,首先在AR方面,由于道路障碍物是全息投影,其深度在大小和距离上与现实生活中的物体一致,所以驾驶员能在自己的视野中尽可能自然地查看道路环境。

其次,该系统从收集的点云数据集中提取360° LiDAR障碍物,加速GPU并行处理,使25个点的处理时间缩短至4.8秒。再次,点云数据收集和障碍物提取形成了一个庞大的点云场景和存储,具有车与车之间共享的概念。因此,处于危险区域的驾驶员将自动收到警报。

研究团队在采集LiDAR数据时使用了3D坐标地面激光扫描仪。扫描仪的参考光束波长为1550 nm,光束发散度为0.35 mrad,测量范围为600 m,数据捕获率为122 kHz,测距精度为5 mm,重复精度为3 mm。

团队利用直立和倾斜位置的LiDAR扫描仪对一条公共道路(英国伦敦马利特街)的 11 个不同位置进行了勘测。收集到的点云数据集包含多种隐藏障碍物,这些障碍物可显示在HUD上,提醒驾驶员注意。

研究人员选择了5个不同的主要障碍物来展示提取隐藏道路物体的概念。选择这些障碍物的标准是:位于不同位置、大小不同、包含不同数量的点。

图1 来源:Advanced Optical Materials

图 1a 展示了扫描对象所在的马利特街鸟瞰图。数据被转换成x、y和z点云数据,经过后处理,在任意坐标系中生成共存点云。研究人员使用开源Python库进行材料分离、几何特征识别和结构分析。

在数据集中,研究人员对每个物体都进行了评估,以确定从扫描角度可见的3D道路障碍物和隐藏物体。他们还针对不同的数据可视化场景选择了3D图像,以评估LiDAR 3D点云数据对驾驶员的优势。

图1b-f展示了下列LiDAR反射图像:(i)道路物体前的一棵树;(ii)附近站着行人的自行车架;(iii-iv)停在路边的一辆卡车;(v)一幢建筑物。每个点云对象都按特定尺寸缩放,以匹配现实生活中的投影对象。

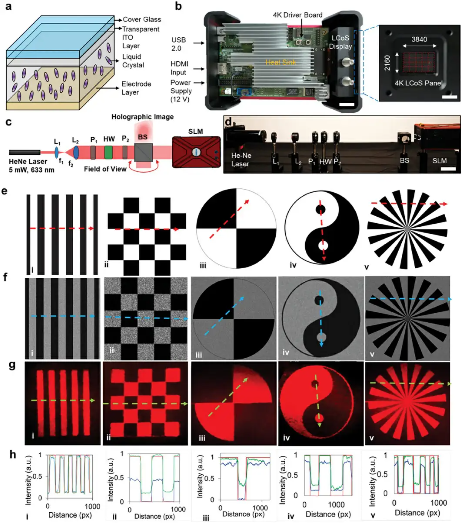

本研究采用的显示技术是硅基液晶(LCoS)。SLM的工作原理是通过改变每个像素的相移和迟滞中施加的电场方向和强度来控制双折射液晶分子的排列(图 2a)。

该装置由夹在导电ITO层和反射涂层之间的液晶层组成。要显示的像素被组织成单独的铝电极,通过向系统施加电压形成电场,从而根据电场强度对准液晶模块。像素的延迟或相移取决于液晶的排列模式。

图2 来源:Advanced Optical Materials

图2b显示了SLM的布局和配置,包括HDMI/USB输入、驱动板和4K LCoS面板(插图)。研究团队设计了一套CGH装置,用于投射LiDAR点云的浮动3D回放场图像(图 2c)。

光学装置采用了4K SLM(3840×2160 px)和He-Ne激光器(λ = 632.8 nm,5 mW)。激光束通过一个非球面透镜(L1,f = 3.30 mm,NA = 0.47)、消色差双透镜(L2,f = 75 mm)、两个设置为45°的线性偏振片(P1/2,透射率38%)、一个聚合物零阶半波板(HW)、一个非偏振分光镜(BS,50:50 分光,30 mm)传播,然后投射到4K SLM的面板上(图 2d)。

精确度、准确度和锐利度等图像特性由调制传递函数(MTF)表征,该函数基于光学系统对给定照明的空间频率响应。

空间频率越高,回放场中的图像就越清晰。有效光学系统的分辨率是通过定义的测试图确定的。分辨率由可分辨的最小细节组之间的距离决定。

为确保超高清回放场结果的准确性,研究人员进行了校准测试,在视野内投射测试目标:线条、棋盘格、Secchi盘、阴阳图和西门子星状图,并测量每个位置的强度(图2e-h)。

图2e展示了目标的原始分辨率图,其中虚线代表分析的投影区域。

从庞大点云提取3D物体,实时投射给驾驶员

总的来说,本研究的重点是一种3D点云方法,该方法能够从庞大的点云中提取选定的3D物体,并将这些物体以 4K 和360°实时投射到驾驶员的视野中。此外,该研究还提出了一种监测回放结果中每个像素亮度的方法,以准确再现3D物体的阴影和遮挡。

与单点处理相比,当点数增加时,并行处理算法得到改进,时间也缩短了。因此,1000个点的算法处理时间仅为26.02秒,10000个点的算法处理时间为243.24秒。

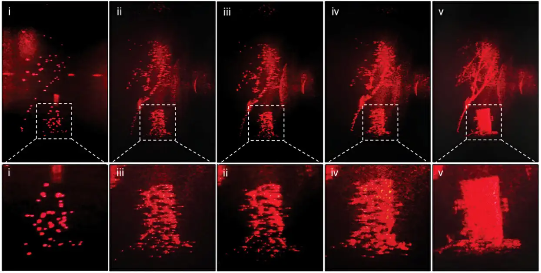

图4 来源:Advanced Optical Materials

图4显示了明确可视化和评估隐藏障碍物所需的点数,即1000个点。对于4K分辨率,所需的点数为400000个点。此外,点云点的密度在任何时候都是受控的,可以降低密度,以便为驾驶员实时投射出障碍物的轮廓。

通过部署LiDAR点云,导航系统的精度和3D物体评估得以不断提高。这种方法可在AR模式下实时实现LiDAR点云对象,以增强HUD功能。

这种点云方法可与交互式城市环境相结合,以监控交通安全并为自主导航提供基础。以前的研究通过生成一种算法,在所选的10厘米位置显示3D回放场图像,探索了点云数据的全息重建。

这种近眼显示技术是通过引入一个能够实时绘制和擦除3D图像的交互式全息系统实现的。此外,通过整合Phong照明模型,全息图可由带有遮挡的点云生成。因此,在回放场结果中会产生反射和阴影。通过重新定位点云网格,利用GPU加速实现了全彩全息回放场结果,分辨率为1080×1080 px。

点云数据可以存储并用于智慧城市的交通预警场景。通过LiDAR点云的方法,隐藏的道路障碍物,如卡车后面的骑车人或遮挡路牌的树木,可以360°投射到驾驶员的视野中,从而减少交通事故。这项工作引入了控制每个像素亮度、点密度控制和全物体旋转的计算方法。

不过,在未来的研究中,可以使用液晶控制的双轴扫描仪对LiDAR扫描仪进行改进,扫描范围为水平方向360°和垂直方向10°。光束扩散角的工作原理为垂直方向0.3° × 0.8°,频率可达100 Hz,旋转角度为0.8°至 3.5°。

例如图1中的卡车和建筑物体只需一次扫描即可采集,这使得人们能够随时在汽车环境中捕捉360°视角,并为道路危险评估提供了宝贵的补充。在研究团队中,不同的研究小组已经对LiDAR点云3D场景识别进行了探索,其他研究小组则将重点放在旋转不变部分与神经网络的集成上。未来基于LiDAR点云的研究可以探索环境3D几何信息识别,并将旋转不变神经网络与GPU加速集成,以实现精准的场景识别和共享选项。

在回放场中,当投影40万个点的障碍物时,确定了全3D 4K精度。从100个点到40万个点的调整对于不同的应用(如驾驶员安全)至关重要。驾驶员需要少于40万个点来全面评估障碍物。

在点云采样应用方面,其他研究人员引入了非均匀采样的2D图像,这些图像经过处理,并根据全息图生成、波前记录平面和深度网格生成创建了3D彩色全息图像。对于一个由1162890个点和6000个深度网格组成的物体,CPU的总运行时间为366.838秒。

其他研究人员则将重点放在了点云点处理的加速方面,他们利用波前记录平面(WRP)方法和FPGA上的递推公式进行定向可分离卷积。例如,使用提议的方法在271秒内处理了4110805个点的蝴蝶,而使用基于层的方法则需要313秒。

不过,对于动态导航系统等其他道路安全应用来说,4K分辨率至关重要。未来的研究可以将光通量重新分配到点云中的各个点上。未来工作的另一个重要方面是,回放场景的结果不会让用户产生视觉疲劳。

未来的研究还可能会涉及驾驶员手势识别,在基于单层元曲面的傅里叶区域提供灵活的 FOV和点云点密度设计,这可以通过改进算法的逻辑架构来实现。另一个重点领域是点云数据存储和与交互式城市环境的按需共享,以便提前告知驾驶员不同的交通情况。这项工作展示了从扫描的LiDAR点云数据中提取的实时4K全息AR视频HUD投影。

注:该研究团队目前正在与谷歌合作,在实际车辆中测试该系统,道路试验可能于2024年开始。

原文链接:

https://onlinelibrary.wiley.com/doi/10.1002/adom.202301772

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)

版权申明:本文为VR陀螺原创,任何第三方未经授权不得转载。如需转载请联系微信:vrtuoluo233 申请授权,并在转载时保留转载来源、作者以及原文链接信息,不得擅自更改内容,违规转载法律必究。文中有图片、视频素材来自互联网或无法核实出处,如涉及版权问题,请联系本网站协商处理。

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息