编译/VR陀螺

今天,美国专利商标局公布了苹果公司的一项专利申请,该专利涉及与电子设备互动的用户界面,更具体地说,是与使用注视点追踪的电子设备互动。

苹果公司的专利描述了使用注视点追踪与电子设备互动的技术。根据一些实施方案,用户可以用眼睛来选择电子设备上显示的文本输入字段。

这些技术提供了一个更自然和有效的界面,在一些示例性的实施方案中,允许用户主要用眼睛的注视来识别要输入的文字。

这些技术可以应用于虚拟现实、增强现实和混合现实设备,也可以应用于传统的设备,如台式电脑、笔记本电脑、平板电脑和智能手机等设备。

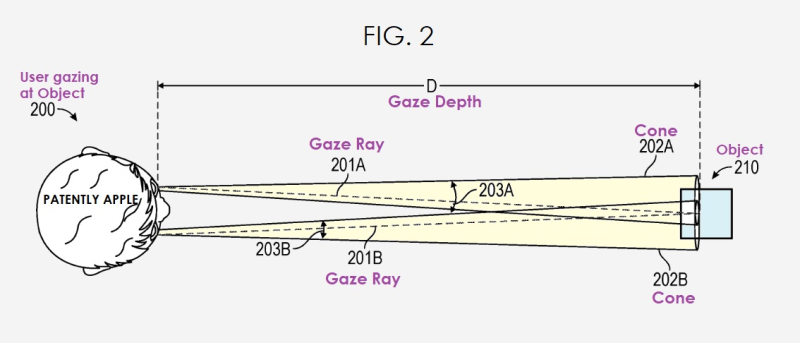

苹果公司的专利图2描述了一个用户(#200)的俯视图,其目光集中在一个物体(#210)上。用户的目光由用户的每只眼睛的视觉轴来定义(如射线201A和201B所描述的)。视觉轴的方向定义了用户的注视方向,而轴线汇聚的距离定义了注视深度。

图源:patentlyapple

图源:patentlyapple

注视方向也可以被称为注视矢量或视线。在图2中,注视方向是在物体的方向,注视深度是相对于用户的距离D。注视方向和/或注视深度是用于确定注视位置的特征。

在一些实施例中,用户的角膜中心、瞳孔中心和/或用户眼球的旋转中心被用于确定用户眼睛的视觉轴的位置。因此,用户的角膜中心、瞳孔中心和/或用户眼球的旋转中心可以用来确定用户的注视方向和/或注视深度。

在一些实施方案中,注视深度是根据用户眼睛视觉轴的汇合点(或用户眼睛视觉轴之间的最小距离的位置)或用户眼睛焦点的一些其他测量数据来确定的。可选的是,注视深度被用来估计用户的眼睛所集中的距离。

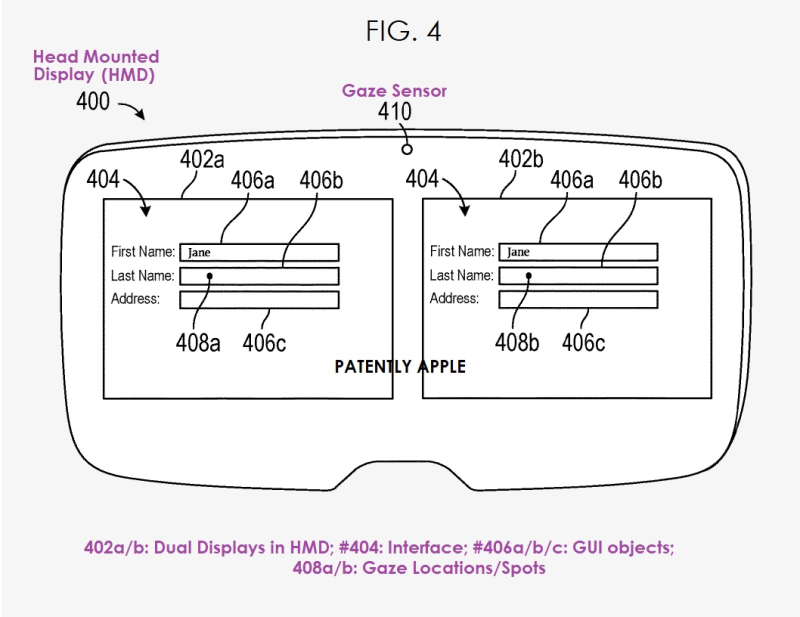

苹果公司的专利图4说明了一种内置注视传感器的头戴式显示器设备(HMD)。用户将能够在VR世界或现实世界的环境中看一个表格,并能够将他们的文字输入引导到表格的特定区域,因为注视传感器检测到了用户的焦点。这项技术非常精准,从 "姓名 "输入槽到下一个方框 "姓氏 "的微小注视都能被准确检测到,这样用户就可以在不使用鼠标的情况下在方框中填写文字。

图源:patentlyapple

图源:patentlyapple

苹果公司指出,注视传感器(#410)朝向用户,在操作过程中,能够捕捉用户眼睛注视的特征,例如用户眼睛的图像数据。

在一些实施方案中,注视传感器包括一个事件相机,该相机根据检测到的光强度随时间的变化检测来自用户(例如,用户的眼睛)的事件数据,并使用该事件数据来确定注视方向和/或注视深度。

HMD同时还可以使用图像数据和事件数据来确定注视方向和/或注视深度。HMD使用射线投射和/或锥体投射来确定注视方向和/或注视深度。在一些实施方案中,使用了多个注视传感器。

苹果公司这项专利的申请号为20210240331,于今天由美国专利商标局公布,该专利最初是在2020年第四季度提交的。

专利中的两位发明人包括Aaron Thompson(高级体验设计师)和Pol Pla(UX和UI原型师,人机界面设计负责人)。还有一位Earl M. Olson,目前并无他的详细职位信息

考虑到这是一项专利申请,带有该专利技术的产品何时会进入市场目前还不得而知。

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息